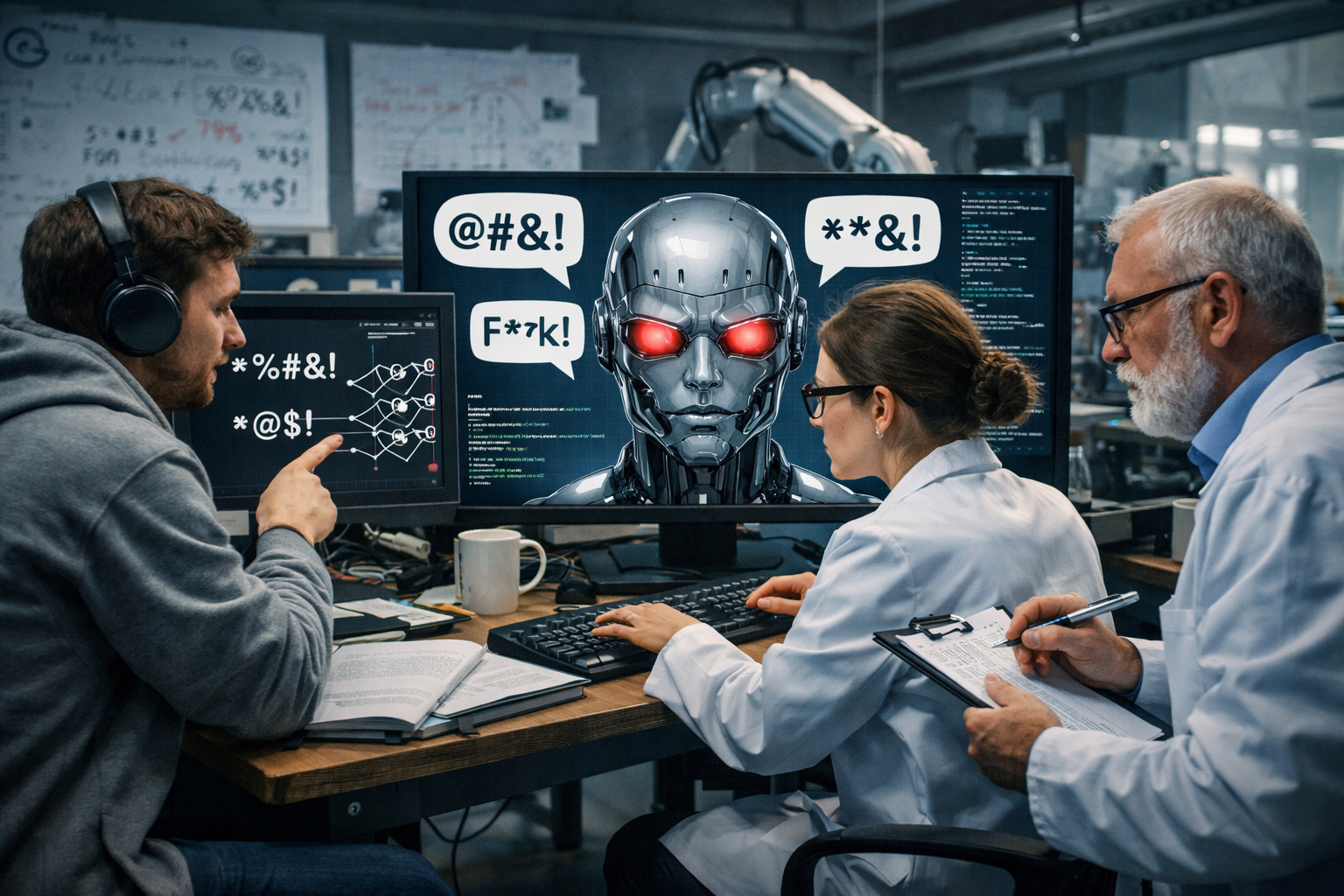

Российские учёные улучшили ИИ с помощью мата

Содержание

Необычный проект

Российские исследователи на протяжении долгого времени изучали задачу перевода грубой лексики в нейтральную разговорную форму. В ходе анализа специалисты обратили внимание на особенность обсценной речи: некоторые матерные слова способны передавать больший объем смысла, чем обычная речь. Наблюдение стало отправной точкой для нового направления исследований, посвященного компактной передаче информации.

Работу проводили ученые из Института AIRI, Высшей школы экономики и университета Иннополис. Их эксперименты показали, что большие языковые модели могут укорачивать русскоязычные тексты за счет мата заметной потери содержания.

Первоначально команда изучала фильтры для материалов с различными возрастными ограничениями. Перед разработчиками стояла задача не только удалять грубые слова, но и сохранять смысл текста. В процессе анализа выяснилось, что большие языковые модели иногда используют нецензурные выражения без четкой функции, вставляя их в предложения случайным образом. Это наблюдение заставило ученых внимательнее изучить роль подобных слов в структуре текста.

Исследователи отметили, что в живой речи одно емкое слово может заменить длинное объяснение и выступать своеобразной сверхплотной упаковкой смысла. На основе этого феномена появилась идея применять такие конструкции для уменьшения длины высказываний. Под сжатием текста специалисты понимали сокращение объема при минимальной потере содержания. Предполагалось, что подобный подход может помочь снизить вычислительные затраты при обработке больших массивов данных.

Техническая сторона эксперимента

Для эксперимента использовались модели Qwen2.5−7B-Instruct и Llama-3.1−8B-Instruct. При этом из-за жестких настроек выравнивания Llama даже после дополнительного обучения практически не генерировала обсценную лексику. В результате исследователи сосредоточились на авторегрессионной модели и применили метод обучения с подкреплением. Для нее разработали составную функцию награды, позволяющую учитывать сразу несколько критериев качества результата. Алгоритм получал штраф, если текст превышал заданную длину, и бонусы за использование обсценной лексики только в роли инструмента сокращения. При этом поощрение начислялось лишь тогда, когда модель одновременно уменьшала объем и сохраняла смысл исходного сообщения.

Словарь соответствий между нейтральными и обсценными выражениями формировали из открытых источников, включая Wiktionary, а затем дополняли вручную. Особое внимание уделялось семантической близости и корректности контекста употребления.

Эксперимент показал, что такой подход позволяет использовать лингвистические особенности языка для оптимизации алгоритмов обработки текста без прямого искажения содержания.

Методику проверяли на двух типах материалов: коротких предложениях длиной от трех до пятидесяти токенов, а также на новостных текстах и редакторских сводках.

Зачем это нужно?

По словам ведущего научного сотрудника AIRI Ильи Макарова, главная цель проекта заключалась не в том, чтобы научить искусственный интеллект ругаться, а в использовании феномена смысловой плотности для совершенствования алгоритмов. Итоговая модель не применяет обсценную лексику при обработке обычных текстов, а обучение на контрастных примерах помогло ей точнее улавливать суть высказываний; при этом области образования, профессионального общения, публичных интерфейсов и официальных сервисов рассматриваются как недопустимые для подобных экспериментов. Работа была представлена на конференции AAAI в Сингапуре.

Подготовлено по материалам с сайта: https://science.mail.ru/news/43980-ii-nauchili-matu/

88 просмотров · 01.06.2026